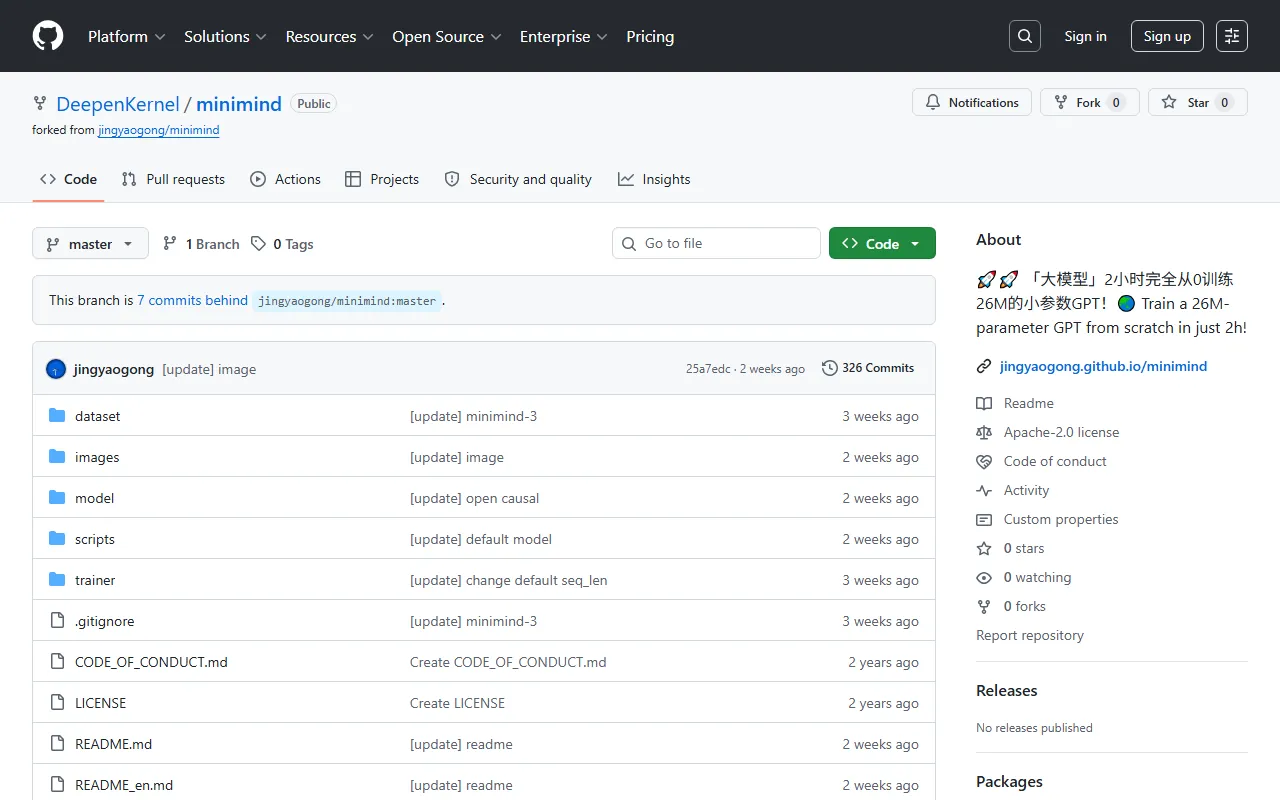

致力于打造超轻量级语言模型的开源项目,专门把大模型从“巨头”变成了普通人也能驯服的“小宠物”。

26M 参数极小语言模型,单 3090 约2 小时训完,适合学习与嵌入式部署。

核心功能

- 完整训练代码:预训练→SFT→LoRA→DPO→RLHF

- 支持文本生成、对话、小知识库

- 拓展多模态 MiniMind-V

多模态版本 (MiniMind-V):https://github.com/jingyaogong/minimind-v

核心功能与亮点

- 极速低成本训练:它的最小模型仅 26M 参数(约为 GPT-3 的 1/7000)。在单张 RTX 3090 显卡上,从零开始预训练仅需约 2 小时,电费成本极低,非常适合个人开发者上手。

- 全流程代码开源:项目不依赖第三方黑盒,所有核心算法均使用 PyTorch 原生重构。完整提供了从预训练、监督微调 (SFT)、LoRA 微调、直接偏好优化 (DPO) 到强化学习 (RLHF) 的全链路代码。

- 强大的文本能力:支持流畅的文本生成与多轮对话,自带小知识库问答能力,推理时显存占用仅约 0.5GB,甚至能在手机等嵌入式设备上运行。

- 多模态视觉拓展:项目拓展出了 MiniMind-V 版本。它引入了 CLIP 视觉编码器,让模型能处理图像 token,实现看图对话、图像描述等视觉语言任务,同样支持单卡快速训练。

项目包含

- MiniMind-LLM结构的全部代码(Dense+MoE模型)。

- 包含 Tokenizer 分词器详细训练代码。

- 包含 Pretrain、SFT、LoRA、RLHF-DPO、模型蒸馏的全过程训练代码。

- 收集、蒸馏、整理并清洗去重所有阶段的高质量数据集,且全部开源。

- 从0实现预训练、指令微调、LoRA、DPO强化学习,白盒模型蒸馏。关键算法几乎不依赖第三方封装的框架,且全部开源。

- 同时兼容transformers、trl、peft等第三方主流框架。

- 训练支持单机单卡、单机多卡(DDP、DeepSpeed)训练,支持wandb可视化训练流程。支持动态启停训练。

- 在第三方测评榜(C-Eval、C-MMLU、OpenBookQA等)进行模型测试。

- 实现 Openai-Api 协议的极简服务端,便于集成到第三方ChatUI使用(FastGPT、Open-WebUI等)。

- 基于 streamlit 实现最简聊天WebUI前端。

- 复现(蒸馏/RL)大型推理模型 DeepSeek-R1 的 MiniMind-Reason 模型,数据+模型全部开源!

快速上手:2 小时从零到一

如果你有一张 3090(或同等算力的 GPU),下面这套流程就能跑通:

第一步,克隆项目安装依赖

bash

git clone --depth 1 https://github.com/jingyaogong/minimind

cd minimind && pip install -r requirements.txt

第二步,下载数据

到 ModelScope 或 HuggingFace 下载 pretrain_t2t_mini.jsonl(1.2GB)和 sft_t2t_mini.jsonl(1.6GB),放到 ./dataset/ 目录。

这是”快速复现”用的精简数据集。如果你想训练完整版 MiniMind-3,对应的是 pretrain_t2t.jsonl(10GB)和 sft_t2t.jsonl(14GB)。

第三步,预训练

bash

cd trainer && python train_pretrain.py

单卡 3090 大约跑 1.2 小时。完成后在 ./out/ 目录会生成 pretrain_768.pth 权重文件。

第四步,有监督微调

bash

python train_full_sft.py

再跑大约 1.1 小时。完成后生成 full_sft_768.pth。

第五步,测试你的模型

bash

python eval_llm.py --weight full_sft

到这里,你就拥有了一个从零训练出来的对话模型。虽然 64M 的参数量不大,知识面和泛化能力有限,但它确实能聊天、能回答问题、能调用工具。

如果你想进一步玩,还有不少可选的进阶路线: – 用 LoRA 做垂域适配(医疗、法律、自我认知等) – 跑 DPO 做偏好优化 – 跑 PPO/GRPO 做强化学习 – 通过 YaRN 实现长文本外推

所有训练都支持断点续训、多卡 DDP 加速、SwanLab 可视化。