OpenWebUI是一款开源、本地部署的人工智能聊天界面工具,旨在为用户提供类似 ChatGPT 的交互体验,但完全运行在自己的设备或私有服务器上。它支持接入多种大语言模型后端(如 Ollama、LM Studio、OpenAI API 等),兼容性强、扩展性高。

OpenWebUI 的核心特点包括:

- 隐私与安全:所有对话和数据均在本地处理,不上传云端,适合对数据安全敏感的场景;

- 可视化操作:提供直观的 Web 图形界面,支持多会话管理、历史记录保存、主题切换等功能;

- 模型自由切换:可灵活配置不同模型,满足翻译、写作、编程、知识问答等多样化需求;

- 开源生态:代码公开,支持二次开发与社区插件扩展,适合技术爱好者自定义功能。

OpenWebUI 本地安装与模型配置的详细教程

一、环境准备

- 操作系统:支持 Windows / macOS / Linux(推荐 Ubuntu 22.04)。

- 硬件要求:建议至少 8GB 内存,CPU 四核以上;若运行较大模型(如 LLaMA 13B),需配备独立显卡(显存 ≥ 12GB)。

- 软件依赖:

- Docker(推荐)或直接 Python 环境

- Git(用于克隆源码)

二、安装步骤(Docker 方式,最简单)

- 安装 Docker

- Windows/macOS:前往 Docker 官网下载并安装 Desktop 版本。

- Linux:执行

sudo apt update && sudo apt install docker.io docker-compose -y

- 拉取 OpenWebUI 镜像

docker pull ghcr.io/open-webui/open-webui:main - 启动容器

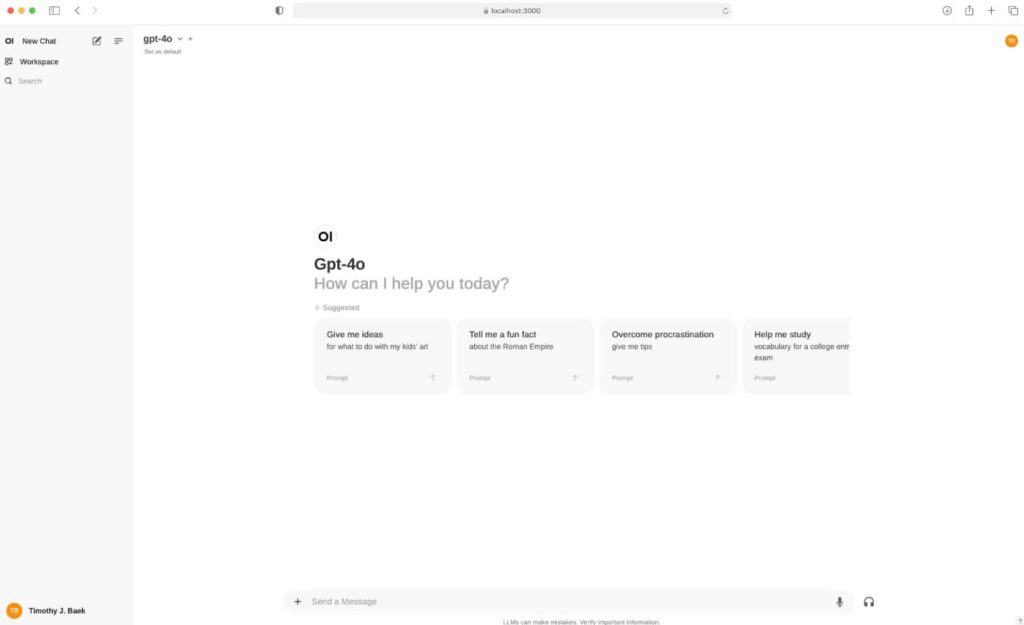

docker run -d --name openwebui -p 3000:8080 ghcr.io/open-webui/open-webui:main访问http://localhost:3000即可进入 Web 界面。

三、模型配置

- 选择后端类型

- 本地模型:Ollama、LM Studio 等

- 远程 API:OpenAI、Claude、Moonshot 等

- 本地模型示例(Ollama)

- 安装 Ollama:

curl -fsSL https://ollama.com/install.sh | sh - 拉取模型:

ollama pull llama2 - 在 OpenWebUI 设置中填写 Ollama 地址(默认

http://localhost:11434)。

- 安装 Ollama:

- API 模式

- 在 OpenWebUI 设置 → Model Provider 中选择对应服务商,填入 API Key 与 Endpoint。

四、常用功能

- 多会话管理:左侧栏新建/切换对话。

- 模型切换:顶部下拉菜单选择当前使用的模型。

- 主题与外观:支持暗色/亮色模式及自定义 CSS。

- 插件扩展:可在源码目录添加自定义前端插件或后端接口。

五、注意事项

- 首次加载模型可能耗时较长,请耐心等待。

- 本地模型占用磁盘空间较大,建议预留 10GB+。

- 如需外网访问,请配置防火墙与反向代理(如 Nginx)。

✅ 完成以上步骤后,你就可以拥有完全本地化、可自由切换模型的 AI 聊天平台。

相关阅读: