Hermes 凭啥打动我,Token 压缩、记忆的成长性。就这两点我就决定卸载小龙虾了! 记忆和Token 小龙虾在这块做得不好,对话一长 context 就膨胀,你能感觉到它越聊越慢越聊越贵,最后要么手动清上下文,要么接受效果打折。 Hermes 完全不是这个思路。

Hermes 凭啥打动我,Token 压缩、记忆的成长性。就这两点我就决定卸载小龙虾了!

记忆和Token

小龙虾在这块做得不好,对话一长 context 就膨胀,你能感觉到它越聊越慢越聊越贵,最后要么手动清上下文,要么接受效果打折。

Hermes 完全不是这个思路。它把记忆拆成四层,每层的加载时机和 Token 策略都不一样:

Prompt Memory 是常驻层。MEMORY.md + USER.md 直接注入系统提示,但卡了一个硬限制,总共 3,575 字符。不是随便设的,是刻意逼 Agent 做精炼而不是堆砌。还有个反直觉的设计:对话中改的记忆要到下一次会话才生效,防止临时信息把上下文污染了。

FTS5 Session Search 解决的是”历史怎么用”。每次对话存 SQLite,全文检索索引。Agent 需要的时候去搜,搜出来的结果经 LLM 摘要才注入不塞整段历史,只拿跟当前任务相关的内容。

Skills 层是程序性记忆。创新点在渐进式加载:默认只加载名称和摘要,完整内容按需调。这意味着 200 个 Skill 和 40 个 Skill 的 Token 成本几乎一样。

最上面是 Honcho,被动用户建模。Agent 在交互中自动追踪你的沟通风格、偏好、领域知识,通过方言式建模在 12 个身份层上持续进化。你不用写任何东西,它在观察你。

四层加在一起的效果:Agent 越用越聪明,Token 账单不会跟着涨。

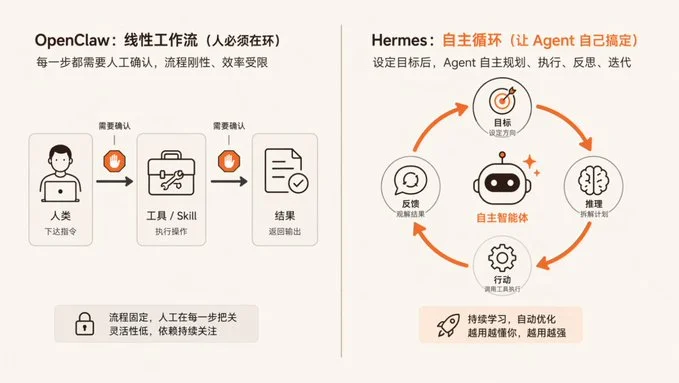

能力比较

直接对比三个核心差异:

(1)闭环学习

小龙虾的 Skill 是你手动创建的,它不会自己学任何新东西。Hermes 不一样,当任务满足触发条件(5 次以上工具调用、错误恢复、用户纠正),Agent 会自动创建 Skill 文件,记录”这条路走通了,下次不用重新摸索”。这些 Skill 还会在使用中自我改进,用 patch 而非 rewrite 更新,只改变化的部分。这不是存储,是经验积累。

(2)Token压缩

小龙虾的压缩是粗暴的,要么丢要么全塞。Hermes 用辅助模型在 context 接近上限时触发压缩,提取关键内容到 3,575 字符限制内,中间轮次做摘要而非丢弃。关键是保留了 Lineage 链,压缩后可以追溯回原始对话,不是不可逆的信息丢失。

(3)Gateway一体化

小龙虾的 Gateway 只管消息投递,Skill 创建、记忆写入、定时任务走独立机制。Hermes 的 Gateway 是学习闭环的一部分:消息进来可以触发 Skill 创建,定时任务输出通过同一层路由回去。Telegram 开始的对话终端里继续,因为 Session 绑定 ID 不绑定平台。

总结和教程

我 100% 确定,Hermes 一定不是最优解,但他是当前阶段最适合解决我的问题的 Agent!

所以啥是好 Agent?是能无缝和自己配合解决自己需求的贴身助理,不是热点,不是流量,不是人云亦云。Agent 好还是不好,一定是你弄懂了而不是别人说清了!

安装过程很简单,我直接让 Claude code 给我安装的,步骤是:

python

#给我安装 Hermes,并把在 openclaw 里面的所有配置迁移过来,包括但不限于和 Telegram 的配置、模型 API Key、Skill、记忆体系等等。当然,如果你还没有用 Claude code,又想跟一下热度去装一下,那么步骤是:

python

curl -fsSL https://raw.githubusercontent.com/NousResearch/hermes-agent/main/scripts/install.sh | bash安装好以后,使用 hermes setup 命令配置就可以

相关阅读:Hermes Agent 开源自进化 AI 智能体

相关阅读:Hermes Agent 新手完整使用指南(2026 最新)

相关阅读:Hermes Agent 新手速查表 – 快速上手,5 分钟就能跑起来